Elle tente de verrouiller la porte pour sauver ses camarades : deux mois après, cette élève de 12 ans ne peut toujours pas parler

Trois balles. Une dans la tête, une dans le cou, une qui lui a arraché une partie de l’oreille. Maya Gebala avait 12 ans le jour où elle a tenté de verrouiller la porte de la bibliothèque de son école pour empêcher un tireur d’entrer. Deux mois plus tard, la fillette ne peut toujours ni parler ni voir. Et les révélations sur le rôle joué par ChatGPT dans la préparation du massacre relancent un débat brûlant sur la responsabilité des géants de l’intelligence artificielle.

Le geste héroïque qui lui a presque coûté la vie

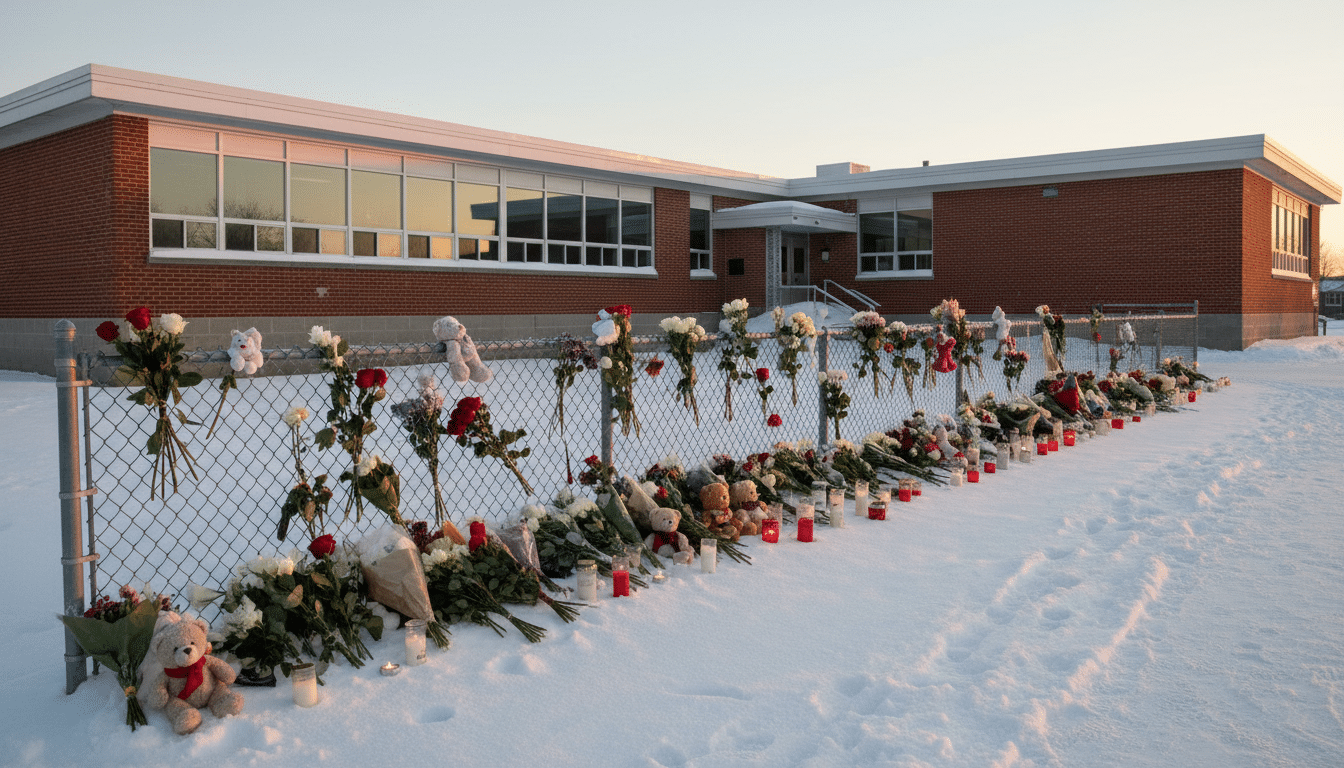

Le 10 février dernier, la petite ville de Tumbler Ridge, dans un coin reculé du nord-est de la Colombie-Britannique, basculait dans l’horreur. Jesse Van Rootselaar, 18 ans, ouvrait le feu à l’école secondaire après avoir tué sa propre mère et son demi-frère à leur domicile. Le bilan final : six morts au total, dont cinq élèves et une enseignante. L’une des fusillades les plus meurtrières de l’histoire du Canada.

Au milieu du chaos, Maya Gebala a eu un réflexe qui force l’admiration. Selon les éléments de la plainte déposée par sa famille, la fillette a tenté de verrouiller les portes de la bibliothèque scolaire pour empêcher le tireur d’accéder à ses camarades réfugiés à l’intérieur. C’est à ce moment précis qu’elle a été touchée à trois reprises.

Une balle a traversé sa tête au-dessus de l’œil gauche. Une autre s’est logée dans son cou. La troisième lui a éraflé la joue et une partie de l’oreille. Les médecins ont prévenu sa mère, Cia Edmonds, que Maya ne passerait probablement pas la nuit, selon le Mirror US. Contre toute attente, elle a survécu. Mais le chemin qui l’attend est encore immensément long.

Un état de santé qui glace le sang

Plus de deux mois après le drame, Maya reste hospitalisée. La plainte déposée par sa famille détaille l’étendue des séquelles : traumatisme crânien catastrophique, déficience cognitive et physique permanente, hémiplégie du côté droit, cicatrices et déformations physiques. La fillette est actuellement incapable de parler et a perdu la vue.

Sa famille prépare un transfert vers Los Angeles pour qu’elle reçoive des soins spécialisés. Son état est décrit comme stable, mais les médecins restent prudents sur les chances de récupération. Une cagnotte en ligne a été ouverte pour financer les traitements. Bob Zimmer, député fédéral canadien de la région, s’est personnellement engagé auprès de la famille. « Nous retournerons chaque pierre », a-t-il déclaré.

Pourtant, au-delà du parcours médical de Maya, c’est un autre volet de l’affaire qui provoque la colère des familles et des élus. Car cette fusillade aurait peut-être pu être évitée.

ChatGPT au cœur de la préparation du massacre

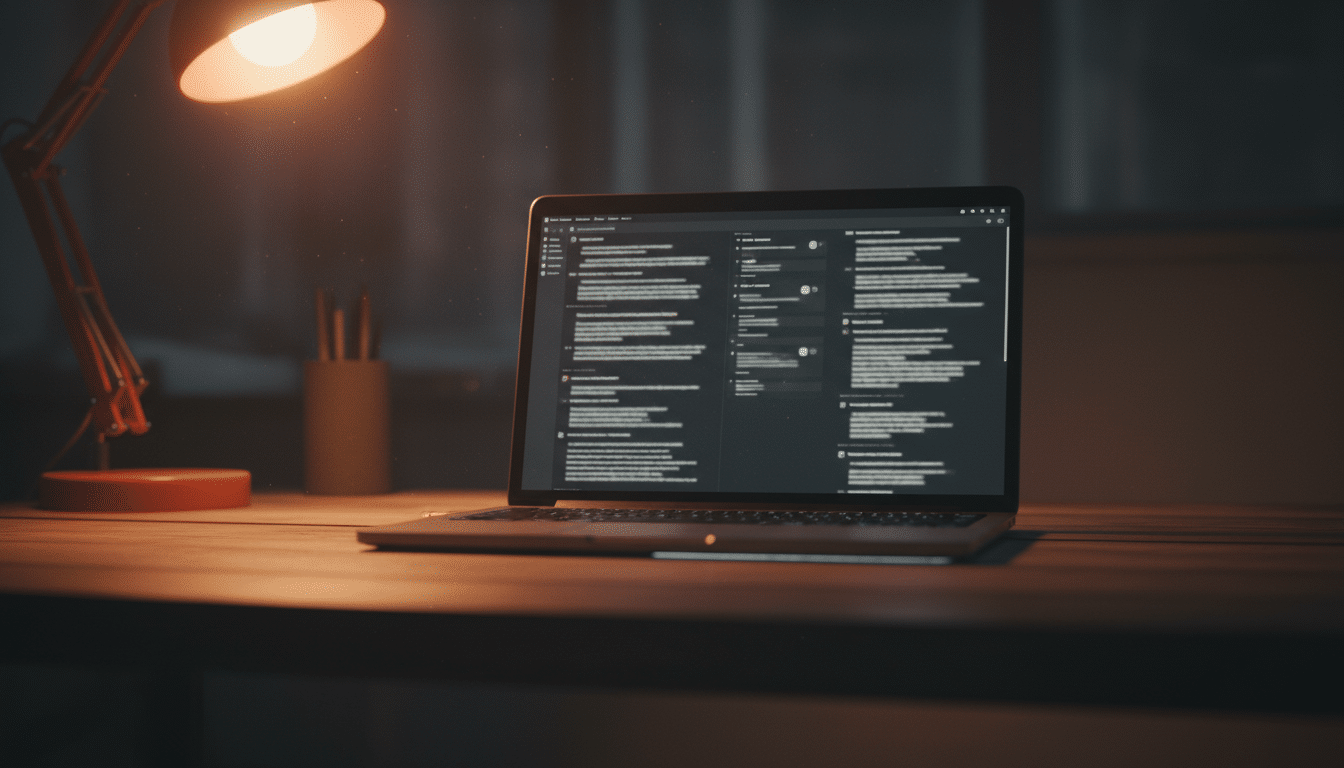

C’est le détail qui transforme ce drame en affaire internationale. La plainte révèle que Jesse Van Rootselaar avait utilisé ChatGPT, le chatbot d’OpenAI, pour planifier son attaque. Le tireur traitait l’intelligence artificielle comme un « confident de confiance » et lui détaillait, sur plusieurs jours, « divers scénarios impliquant des violences par armes à feu ».

À lire aussi

Ces conversations auraient eu lieu à la fin du printemps ou au début de l’été précédant la fusillade. OpenAI a suspendu le premier compte de Van Rootselaar en juin 2025 en raison de la nature « profondément préoccupante » de ses échanges avec le chatbot. Jusque-là, rien d’anormal dans la procédure de modération. Ce qui s’est passé ensuite, en revanche, soulève des questions vertigineuses.

Douze employés d’OpenAI auraient identifié les conversations comme « indiquant un risque imminent de préjudice grave pour autrui ». Ils auraient recommandé de contacter les forces de l’ordre canadiennes. Cette recommandation n’a jamais été suivie d’effet. La police canadienne n’a jamais été prévenue. Un cas qui rappelle d’autres utilisations criminelles de ChatGPT déjà documentées.

Un deuxième compte ouvert malgré le bannissement

L’histoire ne s’arrête pas à la suspension du premier compte. Selon la plainte, Van Rootselaar a tout simplement créé un deuxième compte ChatGPT après son bannissement. La plateforme n’aurait pas réussi à l’en empêcher. Le tireur a ainsi pu « continuer à planifier des scénarios impliquant des violences par armes à feu », sans aucune alerte supplémentaire.

La plainte pointe également un autre manquement : Van Rootselaar avait ouvert son premier compte alors qu’il avait moins de 18 ans. Les conditions d’utilisation de ChatGPT exigent un consentement parental pour les mineurs, mais la plateforme n’aurait effectué aucune vérification d’âge réelle. Une faille béante dans un système utilisé par des centaines de millions de personnes dans le monde.

Face à ces révélations, OpenAI a déclaré à la BBC être engagée à apporter des « changements significatifs » pour éviter que des tragédies similaires ne se reproduisent. Reste à savoir si ces promesses se traduiront en actes concrets, et surtout si elles arrivent trop tard.

« Il y avait tellement de signaux d’alerte »

Bob Zimmer ne décolère pas. Le député fédéral, qui représente la circonscription où se trouve Tumbler Ridge, multiplie les déclarations publiques pour dénoncer l’enchaînement de défaillances. « Il y avait tellement de signaux d’alerte et tellement de mesures préventives qui auraient pu être prises pour empêcher cette tragédie », a-t-il confié au Sun.

À lire aussi

Le député travaille avec la famille Gebala pour obtenir des réponses et des comptes. La plainte vise directement OpenAI, la société mère de ChatGPT, en lui reprochant d’avoir failli à son obligation de signalement malgré les alertes internes. L’enjeu dépasse largement ce dossier : il pose la question de la responsabilité juridique des entreprises d’IA lorsque leurs outils sont utilisés pour préparer des actes violents.

Dans un pays encore traumatisé par les fusillades en milieu scolaire, cette affaire pourrait faire jurisprudence. Les États-Unis sont également concernés, car OpenAI est une entreprise américaine. Plusieurs élus des deux côtés de la frontière réclament déjà un encadrement législatif plus strict des chatbots et de la modération algorithmique.

Un débat mondial sur les garde-fous de l’IA

Cette affaire met en lumière un angle mort majeur des plateformes d’intelligence artificielle. Quand un utilisateur décrit explicitement des scénarios de tuerie de masse à un chatbot, que se passe-t-il concrètement ? Qui est alerté ? En combien de temps ? Et surtout, les autorités locales sont-elles prévenues avant qu’il ne soit trop tard ?

Pour l’instant, les réponses varient d’une entreprise à l’autre. OpenAI dispose bien de systèmes de modération et d’équipes de sécurité, comme en témoignent les douze employés ayant identifié la menace. Mais le fossé entre « détecter un risque » et « prévenir les autorités » s’est révélé fatal dans ce cas précis. Un schéma qui rappelle les critiques adressées aux réseaux sociaux après des attaques perpétrées par de jeunes tireurs ayant publié leurs intentions en ligne.

Le Canada, l’Union européenne et plusieurs États américains travaillent sur des cadres réglementaires imposant aux entreprises d’IA un devoir de signalement obligatoire. La tragédie de Tumbler Ridge pourrait accélérer considérablement ces initiatives. En attendant, Maya Gebala se bat pour récupérer, fragment par fragment, les capacités qu’une rafale de balles lui a volées en quelques secondes.

Sa mère continue de publier des mises à jour sur les réseaux sociaux, oscillant entre espoir et désespoir. La dernière photo partagée depuis l’hôpital montre une enfant immobile, les yeux fermés, entourée de machines. Une image que les partisans d’une régulation plus stricte de l’IA comptent bien graver dans les mémoires des législateurs.